OpenAI und Google stellen die neuen KI-Modelle GPT-5.3 Instant und Gemini 3.1 Flash-Lite vor.

OpenAI hat das GPT-5.3 Instant-Modell in ChatGPT integriert und damit Tonfall, Relevanz und Dialogfluss angepasst. Laut den Entwicklern sollen alltägliche Gespräche mit dem Chatbot dadurch nützlicher und natürlicher werden.

Im Vergleich dazu gab GPT-5.2 Instant bei sensiblen Themen mitunter „übervorsichtige und belehrende“ Antworten. Das aktualisierte Modell neigt deutlich seltener zu Moralisierungen.

Bei der Verarbeitung von Daten aus dem Internet wurden die Antworten von GPT-5.3 Instant aussagekräftiger und strukturierter. Es erkennt den Subtext der Anfrage besser und vergleicht die gefundenen Informationen mit seinem eigenen Wissen und seiner Logik.

Im Allgemeinen ist der Kommunikationsstil des neuen Modells natürlicher geworden, unnötige Phrasen wie „Stopp. Atme durch.“ verschwinden. Das Tool „halluziniert“ weniger und kommt besser mit dem Schreiben von Texten zurecht. OpenAI warnte jedoch, dass die Antworten in manchen Sprachen zu wörtlich klingen könnten.

GPT-5.3 Instant steht ab sofort allen ChatGPT-Nutzern sowie Entwicklern über die API zur Verfügung. Der Support für GPT-5.2 Instant läuft noch bis zum 3. Juni 2026.

Analog zu GitHub

Laut mehreren Medienberichten entwickelt OpenAI ein Pendant zu GitHub. Das Projekt befindet sich noch in der Anfangsphase, aber eine strategische Entscheidung ist bereits gefallen.

Es wird davon ausgegangen, dass der Dienst über ein kostenpflichtiges Abonnement verfügbar sein wird, weitere Details nennen die Journalisten jedoch nicht.

Ein möglicher Grund für die Entwicklung des Produkts waren die regelmäßigen Ausfälle von GitHub, die den OpenAI-Ingenieuren Probleme bereiteten.

Wenn das Unternehmen eine eigene Code-Speicherplattform auf den Markt bringt, wird es zu einem direkten Konkurrenten seines Hauptaktionärs Microsoft (dem Eigentümer von GitHub).

Ende Februar konnte OpenAI Investitionen in Höhe von 110 Milliarden US-Dollar bei einer Bewertung von 730 Milliarden US-Dollar einwerben. Diese Finanzierungsrunde zählt zu den größten in der Geschichte von Startups.

Aktualisierte Gemini-Version

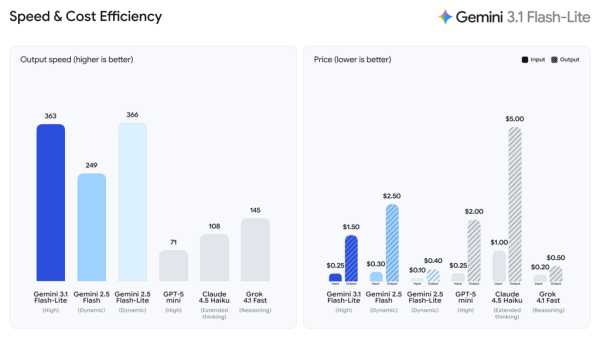

Im Gegenzug veröffentlichte Google eine Vorabversion von Gemini 3.1 Flash-Lite – dem „sparsamsten und schnellsten“ Modell der Gemini 3-Familie.

Die Kosten für den Einsatz eines neuronalen Netzwerks betragen 0,25 US-Dollar pro Million eingehender Token und 1,5 US-Dollar pro Million ausgehender Token.

Das Modell ist für die Erstellung von KI-Agenten und die Skalierung optimiert: Es kann große Datenmengen übersetzen, Inhalte moderieren und Benutzeroberflächen generieren.

Laut unabhängigen Forschern von Artificial Analysis verarbeitet das neue Produkt Informationen 2,5-mal schneller als Gemini Flash 2.5.

Quelle: Google.

Flash-Lite Version 3.1 ist als Vorschauversion für Entwickler über die Gemini API und in Google AI Studio sowie für Unternehmen in Vertex AI verfügbar.

Erinnern wir uns: Im Februar stellte Google Gemini 3.1 Pro vor, ein aktualisiertes KI-Modell, das in Benchmarks Rekorde aufstellte.

Google hat den Deep Think-Modus von Gemini 3 bereits aktualisiert. Das Tool positioniert sich als Lösung für komplexe Probleme in Wissenschaft und Technik.