OpenAI veröffentlicht GPT-5.4 mit Computer Vision

OpenAI veröffentlichte GPT-5.4 und GPT-5.4 Pro zwei Tage nach der Veröffentlichung von Version 5.3 Instant.

GPT-5.4 Thinking und GPT-5.4 Pro werden jetzt in ChatGPT eingeführt.

GPT-5.4 ist jetzt auch in der API und im Codex verfügbar.

GPT-5.4 vereint unsere Fortschritte in den Bereichen logisches Denken, Codierung und agentenbasierte Arbeitsabläufe in einem wegweisenden Modell. pic.twitter.com/1hy6xXLAmJ

– OpenAI (@OpenAI) 5. März 2026

Die Standardversion von GPT-5.4 ist über die ChatGPT-Weboberfläche,die API und das Codex-Tool verfügbar. Die GPT-5.4 Thinking-Version steht Plus-, Team- und Pro-Abonnenten zur Verfügung.

Für Pro-Nutzer und Enterprise-Kunden steht GPT‑5.4 Pro zur Verfügung, das auch über eine API zugänglich ist.

Die Grundnutzungskosten betragen 2,50 $ pro 1 Million eingehender Token und 15 $ pro 1 Million ausgehender Token. Die Gebühren für die Pro-Version sind deutlich höher: 30 $ bzw. 180 $ pro 1 Million Token.

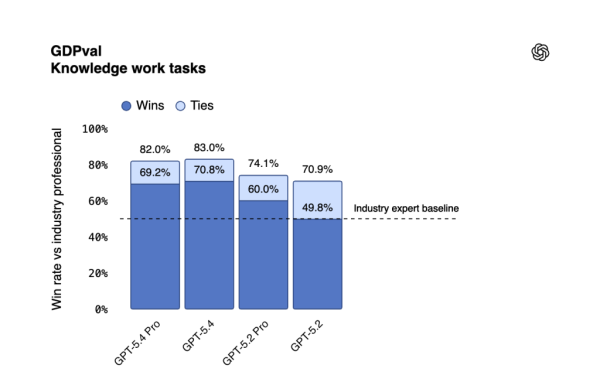

Produktivität bei Arbeitsaufgaben

GPT-5.4 liefert in realen Szenarien stabilere und qualitativ hochwertigere Ergebnisse. Im GDPval-Benchmark, der die Aufgabenleistung in 44 Berufen bewertet, erreichte die Version einen Wert von 83 %. Das bedeutet, dass das Modell auf dem Niveau spezialisierter Fachkräfte arbeitet oder diese sogar übertrifft. Zum Vergleich: GPT-5.2 erzielte 70,9 %.

Quelle: OpenAI.

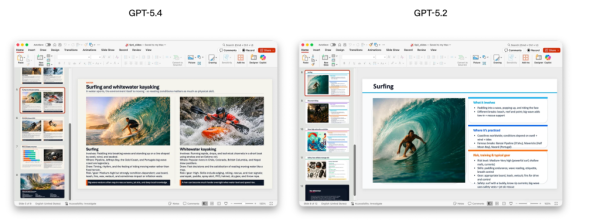

Die Entwickler legten besonderen Wert auf die Arbeit mit Tabellenkalkulationen, Präsentationen und Dokumenten. Bei den Aufgaben für Junior-Investmentbankanalysten erzielte GPT-5.4 87,3 % gegenüber 68,4 % bei GPT-5.2.

Die Gutachter bevorzugten in 68 % der Fälle die Präsentationen des neuen Modells – wegen besserer Ästhetik, größerer Vielfalt und effektiverer Nutzung der Bildgenerierung.

Quelle: OpenAI.

GPT-5.4 erwies sich auch als das präziseste Modell von OpenAI im Umgang mit Fakten. Bei Tests mit Aufgaben, die bekannte Fehler enthielten:

- Die Wahrscheinlichkeit, dass einzelne Aussagen falsch waren, war um 33 % geringer;

- Die vollständigen Antworten enthielten 18 % weniger Fehler als GPT-5.2.

Computer Vision

Diese Version verfügt erstmals über integrierte Bildverarbeitungs- und PC-Steuerungsfunktionen. Das Modell kann Maus und Tastatur bedienen, Screenshots anzeigen und mit Playwright Code für die Automatisierung schreiben.

Das Verhalten wird an spezifische Szenarien angepasst, wobei das akzeptable Risikoniveau berücksichtigt wird.

Im OSWorld-Verified-Benchmark (Desktop-Management) bewältigte GPT-5.4 75 % der Aufgaben erfolgreich und übertraf damit die Vorgängerversion (47,3 %) sowie menschliche Leistungen (72,4 %). Dieser Fortschritt ist auf eine verbesserte visuelle Wahrnehmung zurückzuführen.

- Im MMMU‐Pro-Test (Verständnis und Logik) lag das Ergebnis bei 81,2 % gegenüber 79,5 % im GPT‐5.2;

- In OmniDocBench (Dokumentenanalyse) sank die durchschnittliche Fehlerrate von 0,140 auf 0,109.

Programmierung

In Bezug auf die Codierung ist das Modell auf Augenhöhe mit dem spezialisierten GPT-5.3-Codex, arbeitet aber schneller.

Codex verfügt nun über einen /fast-Modus, der die Generierung um das Eineinhalbfache beschleunigt, ohne Qualitätseinbußen hinnehmen zu müssen. Internen Tests zufolge erzielte GPT-5.4 bei komplexen Frontend-Entwicklungsaufgaben hervorragende Ergebnisse.

Neu eingeführt wurde außerdem die experimentelle Fähigkeit „Playwright (Interactive)“. Sie ermöglicht es dem Modell, Web- und Electron-Anwendungen visuell zu debuggen und den eigenen Code während des Schreibens zu testen.

Werkzeuge

GPT-5.4 führt die Werkzeugsuche ein. Zuvor musste das System die Beschreibungen aller verfügbaren Plugins in den Kontext vorladen. Dies führte zu Tausenden zusätzlicher Tokens pro Anfrage und erhöhte die Kosten.

Das Modell erhält nun lediglich eine Basisliste und ermittelt und lädt die benötigten Parameter selbstständig. Tests mit MCP Atlas zeigten, dass dieser Ansatz den Tokenverbrauch um 47 % reduzierte, ohne die Genauigkeit zu beeinträchtigen.

Die Websuche ist ebenfalls produktiver geworden: Die Benchmark-Werte von BrowseComp stiegen um 17 %, und die Pro-Version erreichte einen Rekordwert von 89,3 %. GPT-5.4 arbeitet effizienter, indem es Informationen aus verschiedenen Quellen sammelt, komplexe Anfragen besser verarbeitet und strukturiertere Antworten liefert.

Verwaltbarkeit und Kontext

Bei komplexen Anfragen zeigt GPT-5.4 Thinking in ChatGPT dem Benutzer zunächst einen Handlungsplan an. So lässt sich die Richtung spontan anpassen, ohne die Generierung neu starten zu müssen oder unnötige Klärungen zu verursachen. Die Funktion ist bereits auf der Website und in der Android-App verfügbar und wird demnächst auch für iOS verfügbar sein.

Das Modell behält auch in längeren Gesprächen den Kontext besser bei und denkt länger über komplexe Aufgaben nach, wodurch die Kohärenz und Relevanz der Antworten auch bei der Verarbeitung großer Informationsmengen erhalten bleibt.

Zur Erinnerung: Anfang März boykottierten die Nutzer ChatGPT aufgrund der Vereinbarung von OpenAI mit dem Pentagon.