Google hat Gemma 4 vorgestellt, eine neue Familie offener KI-Modelle für fortgeschrittenes Schlussfolgerungsvermögen und agentenbasierte Arbeitsabläufe.

Wir haben soeben Gemma 4 veröffentlicht – unser bisher intelligentestes Open-Source-Modell.

Gemma 4 baut auf der gleichen erstklassigen Forschungsgrundlage wie Gemini 3 auf und bringt bahnbrechende Intelligenz direkt auf Ihre Hardware für fortschrittliches Schließen und agentenbasierte Arbeitsabläufe.

Veröffentlicht unter kommerziellen Bedingungen… pic.twitter.com/W6Tvj9CuHW

— Google (@Google) 2. April 2026

„Gemma 4 ist unser bisher intelligentestes offenes Modell. Es bietet ein beispielloses Maß an Intelligenz pro Parameter“, heißt es in der Erklärung.

Seit der Veröffentlichung der ersten Generation wurde Gemma über 400 Millionen Mal heruntergeladen und hat im Gemmaverse-Ökosystem über 100.000 Modellvarianten erstellt. Die neueste Version basiert auf derselben Forschung und Technologie wie der Chatbot Gemini 3.

Verschiedene Größen

Die Gemma 4-Familie neuronaler Netze umfasst vier Versionen: Effective 2B (E2B), Effective 4B (E4B), 26B Mixture of Experts (MoE) und 31B Dense.

Die kompakten E2B- und E4B-Systeme mit 2,3 Milliarden bzw. 4,5 Milliarden aktiven Parametern konzentrieren sich auf Multimodalität, geringe Latenz und nahtlose Integration. Sie können auf einem Smartphone oder einem herkömmlichen Laptop ausgeführt werden.

Die Modelle 26B MoE und das Flaggschiff 31B (mit 26 bzw. 31 Milliarden Parametern) benötigen eine Nvidia-Grafikkarte der H100-Klasse mit 80 GB Speicher. Diese Modelle sind für Forscher und Entwickler optimiert.

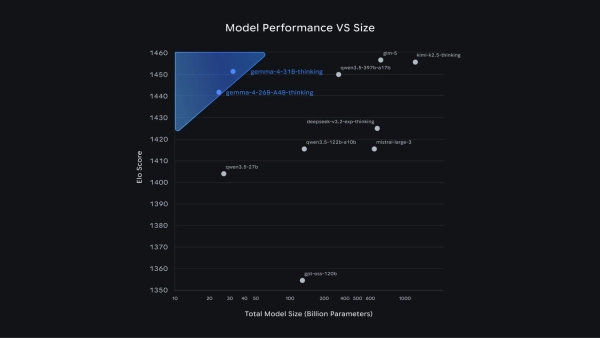

Ältere Versionen erzielen in Benchmarks hervorragende Ergebnisse. Im weltweiten Ranking der Open-Text-Modelle belegt das Flaggschiff Arena AI 31B den dritten Platz, das Modell 26B den sechsten. Laut den Entwicklern übertrifft die neue Produktreihe vergleichbare Modelle der Konkurrenz, die 20-mal größer sind.

Quelle: Google.

Hauptmerkmale

Einer der Hauptvorteile von Gemma 4 sind seine hochentwickelten Denkfähigkeiten. Die Modelle können komplexe Logik aufbauen und Aufgaben in mehreren Schritten planen. Sie zeigen deutliche Fortschritte bei mathematischen Benchmarks und befolgen Anweisungen präzise.

Weitere Merkmale sind:

- Agenten-Workflows – die integrierte Unterstützung für Funktionsaufrufe, strukturierte JSON- Ausgabe und Systemanweisungen ermöglicht es Ihnen, autonome Assistenten zu erstellen, die mit Tools undAPIs interagieren;

- Codegenerierung – Gemma 4 unterstützt das Schreiben von hochwertigem Code im Offline-Modus und verwandelt die Workstation so in einen lokalen KI-Assistenten;

- Bild und Ton – alle Modelle verarbeiten Videos und Bilder mit variabler Auflösung, erkennen Text und analysieren Diagramme. E2B und E4B unterstützen außerdem Spracherkennung und -verständnis;

- Erweitertes Kontextfenster – kompakte Versionen unterstützen 128.000 Tokens, größere Versionen bis zu 256.000. Dies reicht aus, um ganze Repositories oder umfangreiche Dokumente mit einer einzigen Abfrage zu verarbeiten;

- Mehrsprachigkeit – die Modellfamilie kann mit mehr als 140 Sprachen arbeiten.

Gemma 4 ist jetzt in Google AI Studio und der Google AI Edge Gallery verfügbar. Die Integration wird außerdem von gängigen Drittanbieter-Tools und -Frameworks unterstützt, darunter Hugging Face, vLLM, llama.cpp, MLX, Ollama, NVIDIA NIM und LM Studio.

Modelle lassen sich über Google Colab, Vertex AI oder lokale Grafikkarten konfigurieren. Für den Produktiveinsatz steht Google Cloud zur Verfügung, einschließlich Cloud Run, GKE und Sovereign Cloud.

Erinnern Sie sich daran, dass Google Anfang April ein neues KI-Modell zur Videogenerierung vorgestellt hat – Veo 3.1 Lite.