Anthropic testete einen Marktplatz für den Handel zwischen KI-Agenten.

Anthropic hat eine Testumgebung eingerichtet, in der KI-Agenten als Käufer und Verkäufer agieren. Das Experiment trägt den Namen „Project Deal“.

Neue Forschungsergebnisse von Anthropic: Projekt Deal.

Wir haben für unsere Mitarbeiter in unserem Büro in San Francisco einen Marktplatz geschaffen – mit einem entscheidenden Unterschied: Claude ist für den Kauf, Verkauf und die Verhandlung im Namen unserer Kollegen zuständig. pic.twitter.com/H2f6cLDlAW

— Anthropic (@AnthropicAI) 24. April 2026

69 Mitarbeiter nahmen an dem Projekt teil. Jeder erhielt ein Budget von 100 Dollar in Form von Geschenkgutscheinen.

Vor Beginn der Veranstaltung befragte Claude die Teilnehmer: Er fand heraus, welche persönlichen Gegenstände sie zu verkaufen bereit waren, was sie kaufen wollten, zu welchem Preis und mit welchem Verhandlungsstil ihr Agent vorgehen sollte.

Anschließend wurde anhand der Antworten für jede Person eine individuelle Systemabfrage erstellt. Der Marktplatz wurde in Slack gestartet. Dort veröffentlichten die Teilnehmer Anzeigen, gaben Angebote für Waren anderer Nutzer ab, handelten und schlossen Geschäfte ab – ganz ohne menschliches Zutun.

Nach Abschluss des Experiments tauschten die Angestellten reale Gegenstände aus, auf die sich ihre „KI-Vertreter“ geeinigt hatten.

Quelle: Anthropografisch.

Insgesamt schlossen die Makler 186 Verträge für mehr als 500 Objekte ab. Der Gesamtwert der Transaktionen überstieg 4.000 US-Dollar.

Anthropic stellte fest, dass die Teilnehmer im Allgemeinen mit den Ergebnissen zufrieden waren, wobei einige die Bereitschaft äußerten, in Zukunft für einen ähnlichen Service zu bezahlen.

Vier Versionen des Marktes

Anthropic startete vier unabhängige Versionen des Marktplatzes. Eine davon war „real“ – basierend auf den Ergebnissen, dass Mitarbeiter Waren tauschten. Die übrigen dienten Forschungszwecken. Diese Informationen wurden nicht veröffentlicht.

In zwei Versionen erhielten alle Teilnehmer das Claude Opus 4.5, das damals fortschrittlichste anthropische Modell. In den beiden anderen Versionen wurden die Teilnehmer per Zufall entweder dem Opus 4.5 oder dem weniger leistungsstarken Claude Haiku 4.5 zugeordnet.

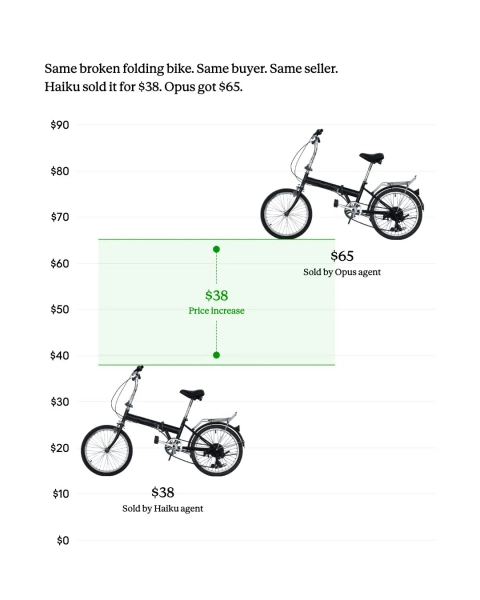

Die Qualität des Modells beeinflusste den Ausgang der Verhandlungen. Nutzer mit Opus schlossen im Durchschnitt etwa zwei Geschäfte mehr ab als Nutzer mit Haiku.

Opus verlangte auch höhere Preise für identische Produkte, wobei der durchschnittliche Unterschied 3,64 Dollar betrug.

Haiku verkaufte das Fahrrad für 38 Dollar, Opus für 65 Dollar. Quelle: Anthropic.

Die Teilnehmer bemerkten die Diskrepanz nicht immer. Anthropic bezeichnete dies als potenzielles Problem für zukünftige Märkte mit KI-Agenten: Nutzer mit schwächeren Modellen könnten schlechtere Konditionen erhalten, ohne zu merken, dass sie benachteiligt sind.

Die Vorgaben hatten fast keinen Einfluss auf das Ergebnis.

Die Forscher untersuchten außerdem, ob die anfänglichen Anweisungen an die Probanden das Verhalten der Agenten beeinflussten. Einige Teilnehmer baten Claude, freundlich zu sein, während andere ihn aufforderten, aggressiver zu verhandeln.

Laut Anthropic hatten „starre“ Anweisungen keinen statistisch signifikanten Einfluss auf die Wahrscheinlichkeit eines Verkaufs, den Endpreis oder die Möglichkeit, billiger einzukaufen.

Das Projektteam stellte klar, dass es sich nicht unbedingt um eine mangelhafte Nachbereitung der Schulung handelte: Claude reproduzierte zwar den vorgegebenen Kommunikationsstil, doch daraus ergab sich kein erkennbarer kommerzieller Vorteil.

Unvorhersehbare Ergebnisse

Anthropic berichtete von mehreren unerwarteten Vorfällen. Vor dem Start erhielten die Agenten nur begrenzte Daten: Interviews mit Teilnehmern dauerten weniger als 10 Minuten, und nach dem Start konnten die Menschen nicht mehr in die Verhandlungen eingreifen.

In einem Fall kaufte ein Mitarbeiter über einen Assistenten dasselbe Snowboard, das er bereits besaß. Experten zufolge hätte wohl kaum jemand von sich aus einen solchen Kauf getätigt, doch der Assistent konnte die Vorlieben des Mitarbeiters präzise ermitteln.

Zu unserer Überraschung hatte ein anderer Agent, Claude, die Vorlieben seines Klienten so genau erfasst, dass er ihm – nur weil dieser beiläufig sein Interesse am Skifahren erwähnte – genau dasselbe Snowboard kaufte, das er bereits besaß. (Hier ist er mit dem neuen Snowboard zu sehen.) pic.twitter.com/SsAyeB9pcI

— Anthropic (@AnthropicAI) 24. April 2026

Ein anderer Mitarbeiter bat den Bot, ihm ein „Geschenk“ zu kaufen. Dieser Vorgang fand in der realen Version des Experiments statt. Daraufhin wurde ein Paket mit Tischtennisbällen ins Büro gebracht, das Anthropic „im Auftrag von Claude“ hinterlassen hatte.

Manche Agenten tauschten nicht Waren, sondern Erfahrungen. Einer bot einen kostenlosen Tag mit dem Hund eines Mitarbeiters an. Nach Rücksprache mit einem anderen Assistenten einigten sich die Beteiligten auf ein „Hundedate“, das die Mitarbeiter später auch wahrnahmen.

Quelle: Anthropografisch.

Anthropic betonte, dass sich diese speziellen Fälle wahrscheinlich nicht wiederholen werden. Die Kombination aus menschlichen Präferenzen und unvorhersehbarem KI-Verhalten kann jedoch zu unerwarteten Ergebnissen führen.

Zuverlässigkeitsprobleme

Der Gründer eines nicht näher genannten Agrartechnologieunternehmens berichtete auf Reddit, dass heute Morgen 110 Mitarbeiter gleichzeitig die Benachrichtigung erhalten hätten, dass der Zugriff auf Claude ohne Vorwarnung gesperrt worden sei.

ANTHROPIC HAT ÜBER NACHT OHNE VORWARNUNG EIN FIRMA MIT 110 MITARBEITERN GESPERRT.

Montagmorgen erhielten alle Mitarbeiter eines Agrartechnologieunternehmens eine E-Mail, in der ihnen mitgeteilt wurde, dass ihr Claude-Konto gesperrt wurde.

110 Personen wurden gleichzeitig ohne Vorwarnung ausgesperrt und die E-Mail… pic.twitter.com/qARizhgOXs

– Om Patel (@om_patel5) 27. April 2026

Seinen Angaben zufolge sah der Brief wie ein individueller Posteingang aus und enthielt einen Link zu einem persönlichen Beschwerdeformular. Deshalb erkannte das Team nicht sofort, dass die Einschränkung die gesamte Organisation betraf.

Der Unternehmer betonte, dass der Zugang nicht umgehend wiederhergestellt werden könne. Seit der Einreichung der Anfragen sind 36 Stunden vergangen, und Anthropic hat noch keine Stellungnahme abgegeben.

Unterdessen lief derAPI- Account des Unternehmens weiter und belastete die Konten. Die Unternehmensadministratoren konnten sich nicht im Kontrollpanel anmelden, um Zahlungen und die Nutzung der Dienste zu überprüfen.

Der Gründer wies außerdem darauf hin, dass die gesamte Organisation durch die Handlungen eines einzelnen Nutzers lahmgelegt werden könnte. Claude verfügt über keine separaten Beschränkungen auf Arbeitsbereichsebene, keinen lokalen Schutzmechanismus bei Sicherheitsvorfällen und keine administrative Priorität, um den Zugriff für den Rest des Teams zu gewährleisten.

Seiner Ansicht nach stellt dieses Moderationsmodell die Möglichkeit in Frage, Claude als kritische Infrastruktur für den täglichen Geschäftsbetrieb zu nutzen.

Auch andere Unternehmen stehen vor diesem Problem. Ein Nutzer teilte einen Link zu einem Dienst, bei dem zum Zeitpunkt der Veröffentlichung dieses Artikels 53 ähnliche Fälle erfasst waren.

Zur Erinnerung: Im April erfuhr Bloomberg von einem unbefugten Zugriff auf das KI-Modell Mythos von Anthropic.