Als Reaktion auf den umstrittenen Vertrag von OpenAI mit dem US-Verteidigungsministerium trat Caitlin Kalinowski als Leiterin der Hardware-Abteilung des Unternehmens zurück.

„Dies war keine leichte Entscheidung. Künstliche Intelligenz spielt eine wichtige Rolle für die nationale Sicherheit. Doch die Überwachung von Amerikanern ohne richterliche Genehmigung und die tödliche Autonomie ohne menschliche Zustimmung sind Themen, die mehr Aufmerksamkeit verdienen, als ihnen derzeit zuteilwird“, schrieb sie.

Kalinowski arbeitete zunächst bei Apple an der Mac-Hardware und wechselte dann zu Meta, wo sie eine wichtige Ingenieurin in der Abteilung Reality Labs wurde. 2024 trat sie OpenAI bei und leitet dort die Abteilung für Robotik und Verbraucherhardware.

In einer Stellungnahme betonte sie, dass es bei der Entscheidung „um Prinzipien und nicht um Personen“ gehe, und brachte ihren „tiefen Respekt“ für OpenAI-CEO Sam Altman und das Team des Startups zum Ausdruck.

„Meiner Meinung nach wurden die Ankündigungen überhastet und ohne Festlegung der Grenzen gemacht. Dies ist in erster Linie ein Managementproblem. Die Unternehmen sind zu wichtig, um übereilte Abschlüsse zu tätigen“, fügte Kalinowski hinzu.

Ein Vertreter von OpenAI betonte, dass die Vereinbarung mit dem Pentagon „einen Arbeitsweg für den verantwortungsvollen Einsatz von KI für Zwecke der nationalen Sicherheit schafft und gleichzeitig die roten Linien klar umreißt: keine Überwachung im Inland und keine autonomen Waffensysteme.“

„Wir verstehen, dass die Menschen zu diesen Themen starke Überzeugungen haben, und wir werden sie auch weiterhin mit Arbeitnehmern, Regierungen und der Gesellschaft auf der ganzen Welt diskutieren“, fügte er hinzu.

Der Vertrag zwischen OpenAI und dem Pentagon wurde Ende Februar unterzeichnet, kurz nachdem die Verhandlungen zwischen Anthropic und dem Verteidigungsministerium gescheitert waren.

Altman räumte bald ein, dass der Deal „überhastet“ gewesen sei und „nicht sehr gut“ für das Image des Startups aussehe.

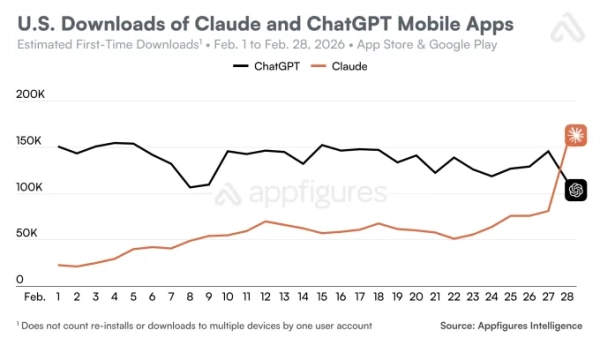

Die Situation wirkte sich negativ auf die Popularität von ChatGPT und Claude aus. Die Zahl der Deinstallationen des erstgenannten Chatbots stieg um 295 %, während Claude an die Spitze der App-Store-Charts aufstieg.

Downloadzahlen der mobilen Apps Claude und ChatGPT in den USA. Quelle: Appfigures.

Konfrontation zwischen den Behörden und Anthropic

Im Juli 2025 vergab das US-Verteidigungsministerium Aufträge im Wert von bis zu 200 Millionen Dollar an Anthropic, Google, OpenAI und xAI zur Entwicklung von KI-Lösungen für die Sicherheit.

Im Januar 2026 berichtete das Wall Street Journal, dass der Vertrag mit Anthropic vor dem Aus stand. Die Meinungsverschiedenheiten entstanden aufgrund der strengen Ethikrichtlinien des Startups. Diese verbieten den Einsatz des Claude-Modells für Massenüberwachung und autonome Tötungsoperationen.

Im Februar 2026 setzte die US-Armee Claude bei einer Operation zur Gefangennahme des venezolanischen Präsidenten Nicolás Maduro ein, woraufhin der Konflikt eskalierte.

Der Geschäftsführer des Unternehmens, Dario Amodei, traf sich mit Verteidigungsminister Pete Hegseth, um die Situation zu besprechen. Das Ministerium stellte ein Ultimatum: Anthropic muss die Bedingungen der Regierung bis zum 27. Februar akzeptieren.

Amodei erklärte, er würde lieber nicht mit dem Pentagon kooperieren, als der Nutzung seiner Technologie zuzustimmen, die „demokratische Werte eher untergraben als schützen“ könnte.

Ende Februar wies US-Präsident Donald Trump alle Bundesbehörden an, innerhalb von sechs Monaten vollständig auf die Nutzung anthropischer Technologien zu verzichten.

Er bezeichnete das Start-up als ein „außer Kontrolle geratenes“ Unternehmen, das von Leuten geführt werde, die „keine Ahnung von der Realität haben“.

Das Pentagon hat Anthropic offiziell als „Lieferkettenrisiko“ eingestuft, wodurch die Geschäftsbeziehungen des Unternehmens mit anderen Regierungsauftragnehmern gefährdet sind. Microsoft und Google haben erklärt, dass sie Anthropic weiterhin mit ihren Produkten beliefern werden.

Ich werde vor Gericht gehen.

Amodei erklärte, sein Unternehmen werde die Entscheidung des Verteidigungsministeriums, das Unternehmen als Lieferkettenrisiko einzustufen, gerichtlich anfechten. Der Geschäftsmann hält sie für „rechtlich unbegründet“.

In der Berufung wird ausgeführt, dass die Entscheidung des Pentagons für die große Mehrheit von Claudes Kunden nicht gilt.

Laut Amodei hatte das Unternehmen mehrere Tage lang produktive Gespräche mit dem Verteidigungsministerium geführt, die jedoch nach dem Durchsickern eines internen Memos abgebrochen wurden. Darin beschrieb der CEO die Beziehung von OpenAI zur Behörde als „eher eine Sicherheitsdemonstration als einen echten Schutz vor Risiken“.

Amodei entschuldigte sich für das Leck und erklärte, das Unternehmen habe den Inhalt des Memorandums versehentlich preisgegeben und niemanden dazu angewiesen.

„Es liegt nicht in unserem Interesse, die Situation zu verschlimmern“, schrieb er.

Der CEO des Startups betonte, dass das Dokument nur wenige Stunden nach einer Reihe von Ankündigungen verfasst wurde, wonach Anthropic aus den Systemen der US-Bundesbehörden entfernt werden sollte. Er entschuldigte sich für den Tonfall und bezeichnete den Tag als „schwierig für das Unternehmen“.

Amodei fügte hinzu, dass das Memo eine „veraltete Einschätzung“ darstelle und nicht auf „sorgfältige und ausgewogene Überlegungen“ zurückzuführen sei. Er sagte, die oberste Priorität des Unternehmens sei es, sicherzustellen, dass amerikanische Soldaten und nationale Sicherheitsexperten während laufender großangelegter Kampfeinsätze Zugang zu wichtigen Instrumenten hätten.

Anthropic wird das Verteidigungsministerium weiterhin so lange mit seinen Modellen „zum Nennwert“ beliefern, wie dies erforderlich ist.

Der ehemalige KI-Berater des Weißen Hauses, Dean Ball, merkte an, dass es für das Unternehmen schwierig sein dürfte, gegen die Entscheidung des Pentagons Berufung einzulegen.

„Gerichte zögern sehr, Regierungsentscheidungen darüber in Frage zu stellen, was die nationale Sicherheit betrifft und was nicht. Dafür muss eine sehr hohe Hürde überwunden werden. Aber es ist nicht unmöglich“, bemerkte der Experte.

Zur Erinnerung: Im Februar lockerte Anthropic seine wichtigsten Sicherheitsrichtlinien und begründete dies mit der Notwendigkeit, die Wettbewerbsfähigkeit zu erhalten.